在2024年8月,一組前Stability AI的開發者宣布成立Black Forest Labs,並發布了他們的第一個AI模型FLUX.1,該模型基於120億個參數,並基於新穎的變壓器架構進行訓練。

提示:創建一幅觀眾正在看著人眼的圖像。(男人)在眼睛的反射中,描繪一個未來主義和戰爭蹂躪的世界。風景應該被先進的AI技術所佔據,例如高聳的機器人、自主無人機,以及覆蓋著數位廣告和全息圖的破舊建築。整體氛圍應該是黑暗和反烏托邦的,帶有冷冽的金屬色調和毀滅的暗示。眼睛本身應該看起來像是核爆炸,但帶有人工增強的暗示,如發光的賽博網眼

提示:創建一幅觀眾正在看著人眼的圖像。(男人)在眼睛的反射中,描繪一個未來主義和戰爭蹂躪的世界。風景應該被先進的AI技術所佔據,例如高聳的機器人、自主無人機,以及覆蓋著數位廣告和全息圖的破舊建築。整體氛圍應該是黑暗和反烏托邦的,帶有冷冽的金屬色調和毀滅的暗示。眼睛本身應該看起來像是核爆炸,但帶有人工增強的暗示,如發光的賽博網眼

對於這個模型的反響非常正面。用戶對圖像質量和提示識別的優秀表現感到驚訝。

使Flux.1模型更加特別的是,它是一個開源模型,因此社區將能夠在其上構建,通過訓練具有不同能力的自定義模型和LORA。

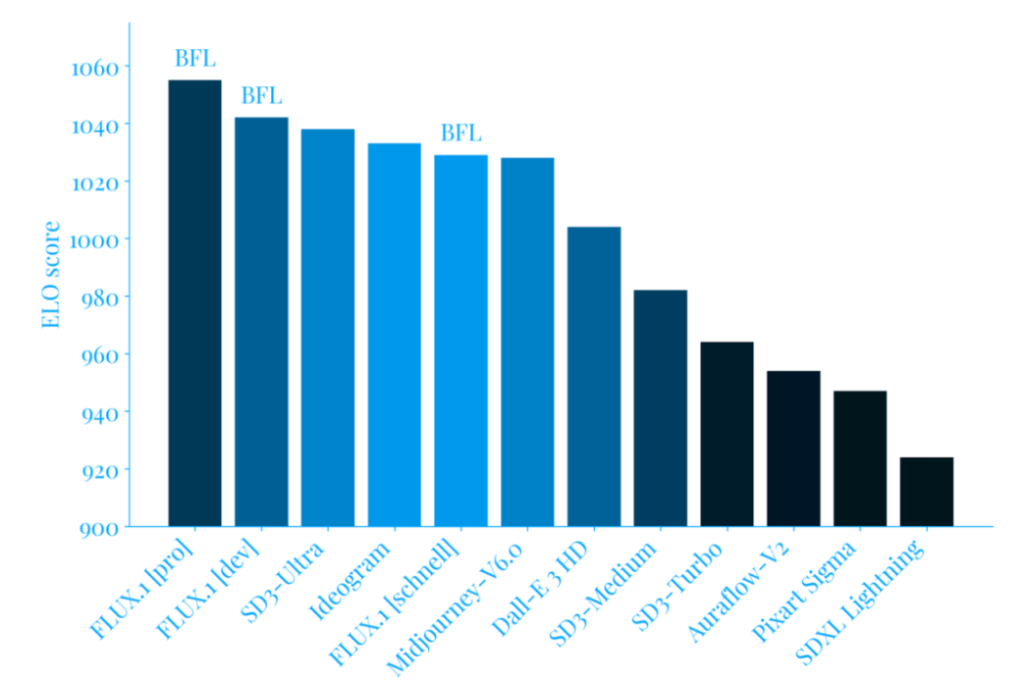

Flux.1由三個模型變體組成;

- Flux.1 [Pro] – Pro是僅可通過API使用。您可以使用Black Forest Labs的own API,或其多個商業合作夥伴,使用Flux.1 Pro生成圖像。權重(模型文件)無法下載,即使可以,系統要求也會超過消費者硬體的使用。

- Flux.1 [Dev] – Dev是一個用於非商業應用的開源模型。從Flux.1 [Pro]中提煉而來,提供類似的圖像質量和提示識別能力,同時更高效;我們可以在消費者硬體上本地運行它。Flux.1 [Dev]根據非商業許可證發布。從Hugging Face這裡下載。

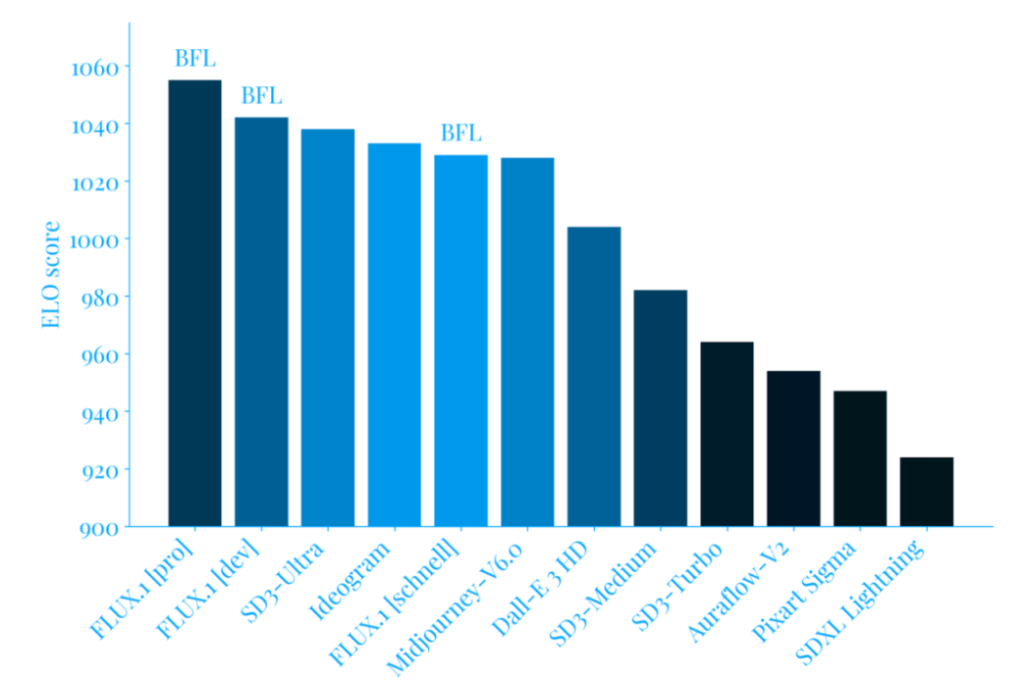

FLUX.1的表現如何?我可以期待什麼樣的質量?

許多AI愛好者形容它為“我們一直在等待的模型”(尤其是在SD3失望之後),Flux受到熱烈的歡迎。圖像的真實性、提示遵循性和整體圖像質量都非常出色,為text2img領域樹立了新的標準。

來看看這些例子:

而且我們不能忘記NSFW的能力(更多NSFW提示在這裡):

我如何在線試用Flux?

您可以在Hugging Face上免費使用FLUX.1(有限使用)。這裡是Dev和Schnell模型的生成器。

您也可以在Replicate.com上運行FLUX.1:Dev和Schnell(同樣有限的免費使用)。

我如何在本地使用Flux?

目前,根據您的硬體,有幾個本地生成的選擇!

在撰寫時,尚未支持Automatic1111。

讓我們來看看我們的選擇:

- SwarmUI(我個人的推薦)

- Forge

- ComfyUI

使用SwarmUI

這裡是下載鏈接:

https://github.com/mcmonkeyprojects/SwarmUI

按照說明操作,這裡重複一下:

注意:如果您使用的是Windows 10,您可能需要手動安裝git和DotNET 8。 (Windows 11這是自動的)。

- 下載The Install-Windows.bat文件,將其存儲在您想要安裝的位置(不是Program Files),然後運行它。對我來說是在D:驅動器上,但這取決於您。

- 它應該會打開命令提示符並自動安裝。

- 如果它在沒有進一步操作的情況下關閉,請嘗試再次運行,有時需要運行兩次。

- 它會在您的桌面上放置一個圖標,您可以隨時使用它重新啟動服務器。

- 當安裝程序完成時,它將自動啟動

StableSwarmUI服務器,並打開一個瀏覽器窗口到安裝頁面。

- 按照頁面上的安裝說明操作。

- 提交後,請耐心等待,某些安裝處理需要幾分鐘(下載模型等)。

這應該完成安裝,提供SD XL Base模型。

要啟動它,雙擊“Launch-Windows.bat”文件。它還會在您的桌面上放置一個快捷方式,除非您告訴它不這樣做。

嘗試使用XL模型創建圖像。如果那樣可以,太好了!

從這裡下載Flux模型:

還要下載對應的“ae.safetensors”文件,根據您選擇的模型。

將您選擇的FLUX文件放入您的unet文件夾:

SwarmUI\Models\unet

然後將“ae.safetensors”文件放入您的VAE文件夾:

SwarmUI\Models\VAE

關閉應用程序,包括瀏覽器和控制台。

使用Windows-launch.bat文件重新啟動Swarm。

您應該能夠選擇Flux作為模型,嘗試創建圖像。

它會告訴您它在隊列中。

您需要等待,因為Swarm正在下載大型文件。您可以在控制台中檢查進度。

當下載完成時,您的第一幅圖像應該會開始出現!

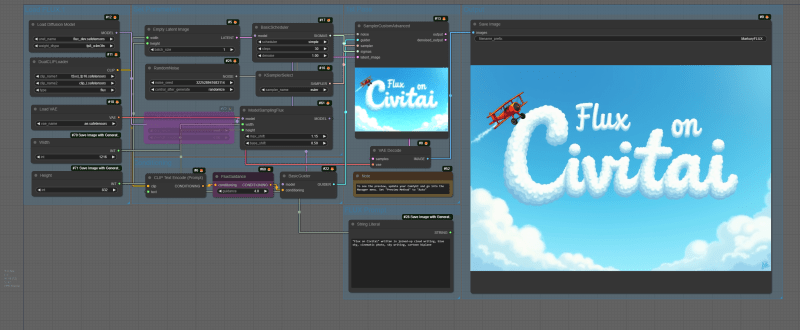

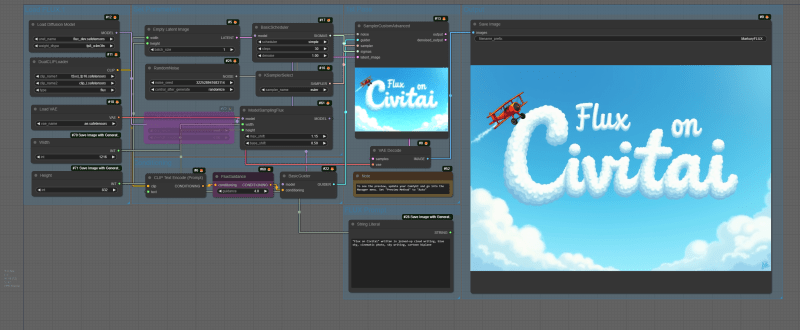

ComfyUI

Flux.1在第一天就推出了ComfyUI支持,使其成為使用原始Black Forest Labs模型生成的最快和最簡單的方法之一。要開始使用Flux與ComfyUI,您需要以下組件:

- 請注意,Flux-dev和-schnell .safetensors模型必須放入ComfyUI\models\unet文件夾中。

- Clip模型必須放入ComfyUI\models\clip文件夾中。如果您之前使用過SD3,您可能已經擁有所需的Clip模型。

- 一些系統要求考慮事項;

- flux1-dev需要超過12GB的VRAM

- flux1-schnell可以在12GB VRAM上運行

- 如果您的系統RAM少於32GB,請使用t5xxl_fp8_e4m3fn文本編碼器,而不是t5xxl_fp16版本。

⚠️ 如果您無法運行“完整”的官方模型,創建者Kijai 已發布了壓縮的fp8版本的flux1-dev和flux1-schnell。雖然圖像質量可能會有所降低,但這些版本使得擁有較少可用VRAM的用戶能夠使用Flux生成。

您還需要一個基本的文本到圖像工作流程來開始。下面的下載鏈接提供了一個簡單的設置,帶有一些穩定的預設選項。此外,我們還包含了一個LoRA加載器(默認被繞過),因為我們已經看到第一批Flux LoRA出現在Civitai上!

civitai_flux_t2i_workflow下載

Forge

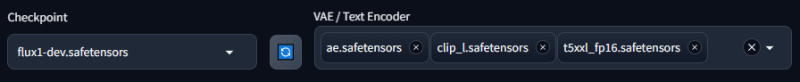

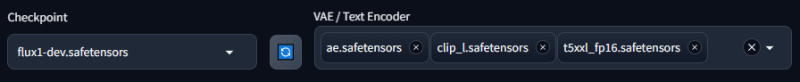

我們最喜愛的介面之一,Forge,在一次驚喜的重大更新中獲得了Flux支持!如果您熟悉Automatic1111的介面,您會在Forge中感到如魚得水;Gradio前端幾乎是相同的。

Forge可以支持原始Flux模型和文本編碼器,如上面為Comfy列出的。

要使用完整的模型和文本編碼器,模型和編碼器可以加載到新的字段中;

Forge的創建者,Illyasviel,發布了一個“壓縮”的NF4模型,這是目前推薦的使用Flux與Forge的方式;“NF4在6GB/8GB/12GB設備上比FP8快得多,對於>16GB VRAM設備略快。對於6GB/8GB VRAM的GPU,速度提升約為1.3x到2.5x(pytorch 2.4,cuda 12.4)或約1.3x到4x(pytorch 2.1,cuda 12.1)“

注意!如果您的GPU支持CUDA版本高於11.7,您可以使用NF4模型。大多數RTX3XXX和4XXX GPU支持NF4)。

如果您的GPU是GTX10XX/20XX,則可能不支持NF4。在這種情況下,請使用fp8模型。