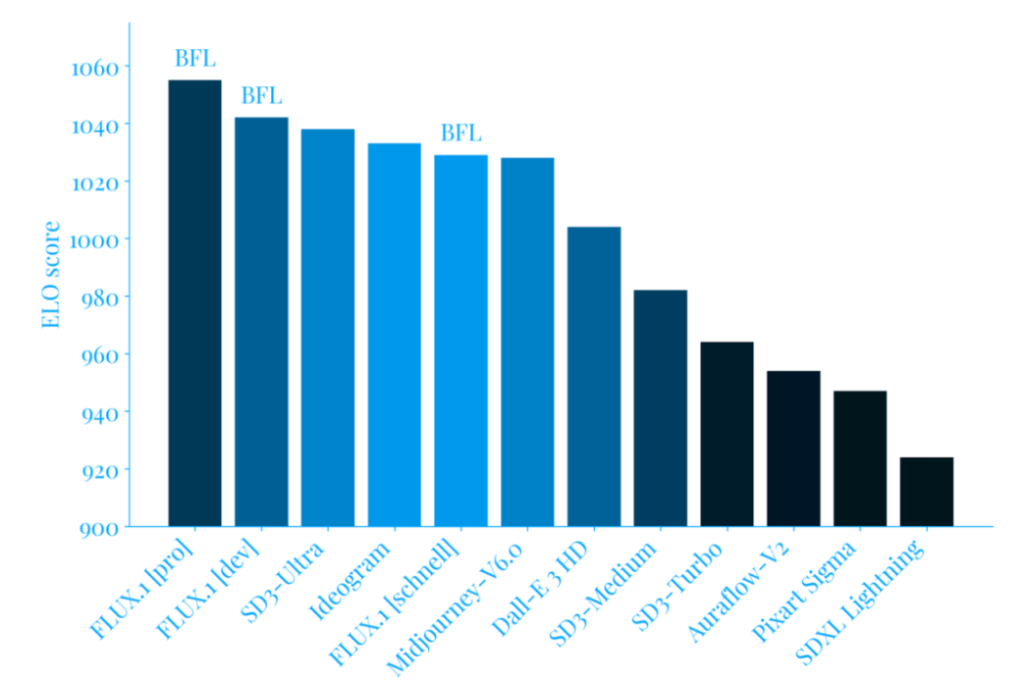

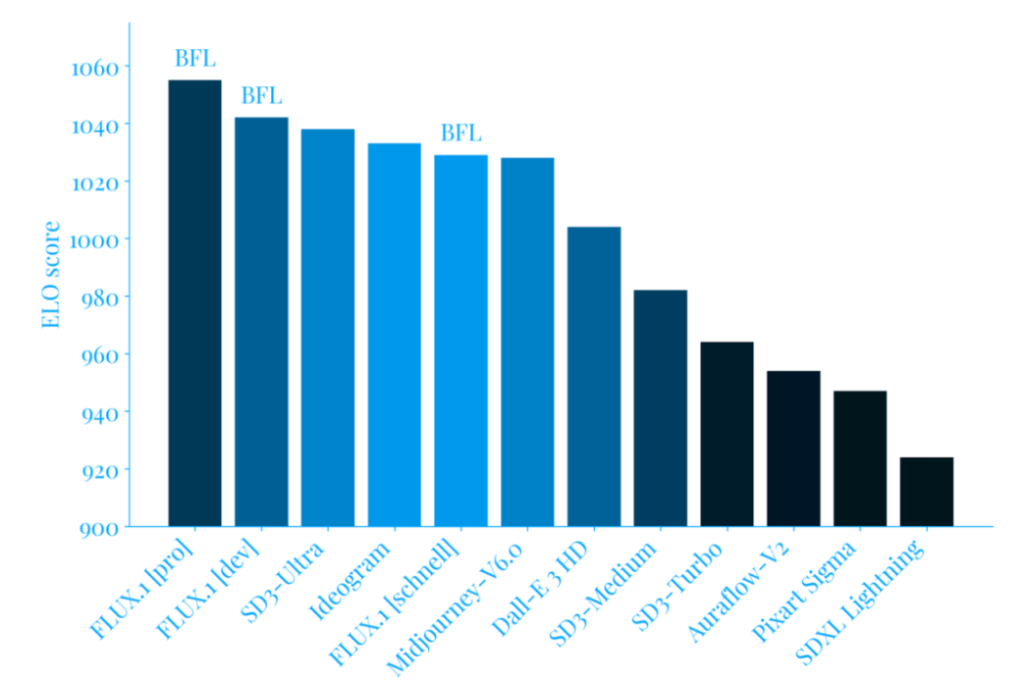

2024年8月、元Stability AIの開発者チームがBlack Forest Labsの設立を発表し、12億のパラメータで訓練された最初のAIモデルFLUX.1をリリースしました。このモデルは新しいトランスフォーマーアーキテクチャに基づいています。

プロンプト: 視聴者が人間の目を見つめている画像を作成してください。(男性)目の反射には、未来的で戦争に荒廃した世界を描写してください。風景には、高層ロボット、自律型ドローン、デジタル広告やホログラムで覆われた老朽化した建物などの高度なAI技術が溢れているべきです。全体的な雰囲気は暗くディストピア的で、冷たい金属的なカラーパレットと破壊のヒントが含まれるべきです。目自体は核爆発のように見えますが、人工的な強化のヒント、例えば光るサイボーグの虹彩を持っています。

プロンプト: 視聴者が人間の目を見つめている画像を作成してください。(男性)目の反射には、未来的で戦争に荒廃した世界を描写してください。風景には、高層ロボット、自律型ドローン、デジタル広告やホログラムで覆われた老朽化した建物などの高度なAI技術が溢れているべきです。全体的な雰囲気は暗くディストピア的で、冷たい金属的なカラーパレットと破壊のヒントが含まれるべきです。目自体は核爆発のように見えますが、人工的な強化のヒント、例えば光るサイボーグの虹彩を持っています。

このモデルへの反応は圧倒的に好意的でした。ユーザーは画像の品質とプロンプト認識の良さに驚きました。

Flux.1モデルを特別なものにしているのは、オープンソースモデルであるため、コミュニティがカスタムモデルや異なる機能を持つLORAを訓練して構築できることです。

Flux.1は3つのモデルバリエーションで構成されています;

- Flux.1 [Pro] – ProはAPIを介してのみ使用可能です。Black Forest LabsのAPIや、彼らの商業パートナーのいくつかを使用してFlux.1 Proで画像を生成できます。ウェイト(モデルファイル)はダウンロードできず、たとえできたとしても、システム要件は消費者ハードウェアでの使用には高すぎます。

- Flux.1 [Dev] – Devは非商業用途のためのオープンソースモデルです。Flux.1 [Pro]から抽出され、類似の画像品質とプロンプト認識機能を提供しつつ、より効率的です。消費者ハードウェアでローカルに実行できます。Flux.1 [Dev]は非商業ライセンスの下でリリースされています。Hugging Faceからダウンロードできます。

FLUX.1はどれほど優れているのか?どのような品質を期待できるのか?

多くのAI愛好者によって「私たちが待っていたモデル」と評されているFluxは(特にSD3の失望の後)、歓迎され、受け入れられました。画像の忠実度、プロンプトの遵守、全体的な画像品質は卓越しており、text2imgの分野で新たな基準を設定しています。

これらの例を見てみましょう:

そして、NSFW機能もお忘れなく(こちらでNSFWプロンプトの詳細):

Fluxをオンラインで試すにはどうすればよいですか?

FLUX.1はHugging Faceで無料(制限付き)で使用できます。DevとSchnellモデルのジェネレーターはこちらです。

また、Replicate.comでFLUX.1を実行することもできます:DevとSchnell(こちらも制限付きの無料使用)。

Fluxをローカルで使用するにはどうすればよいですか?

現在、ハードウェアに応じてローカル生成のためのいくつかのオプションがあります!

執筆時点ではAutomatic1111のサポートはありません。

オプションを見てみましょう:

- SwarmUI(私の個人的なおすすめ)

- Forge

- ComfyUI

SwarmUIの使用

こちらがダウンロードリンクです:

https://github.com/mcmonkeyprojects/SwarmUI

指示に従ってください。ここでも繰り返します:

注意:Windows 10を使用している場合は、最初にgitとDotNET 8を手動でインストールする必要があるかもしれません。(Windows 11では自動化されています)。

- Install-Windows.batファイルをダウンロードし、インストールしたい場所(Program Filesではない)に保存して実行します。私の場合はD:ドライブですが、あなた次第です。

- コマンドプロンプトが開き、自動的にインストールされるはずです。

- もし閉じてしまった場合は、再度実行してみてください。時々、二回実行する必要があります。

- デスクトップにサーバーを再起動するためのアイコンが作成されます。

- インストーラーが完了すると、自動的に

StableSwarmUIサーバーが起動し、インストールページがブラウザウィンドウに開きます。

- ページのインストール手順に従ってください。

- 送信後は、少し待ってください。インストール処理の一部には数分かかることがあります(モデルのダウンロードなど)。

これでインストールが完了し、SD XL Baseモデルが提供されます。

起動するには、「Launch-Windows.bat」ファイルをダブルクリックします。デスクトップにショートカットが作成されているはずです。もし作成されていなければ、そう指示した場合です。

XLモデルで画像を作成してみてください。それがうまくいけば、素晴らしいです!

Fluxモデルをこちらからダウンロードしてください:

選択したモデルに対して「ae.safetensors」ファイルもダウンロードしてください。

選択したFLUXファイルをunetフォルダーに入れてください:

SwarmUI\Models\unet

次に、「ae.safetensors」ファイルをVAEフォルダーに入れてください:

SwarmUI\Models\VAE

アプリを閉じて、ブラウザとコンソールの両方を終了します。

Windows-launch.batファイルでSwarmを再起動します。

Fluxをモデルとして選択できるはずです。画像を作成してみてください。

キューに入っていることを伝えられます。

待つ必要があります。Swarmが大きなファイルをダウンロードしているためです。進捗はコンソールで確認できます。

ダウンロードが完了すると、最初の画像が表示され始めるはずです!

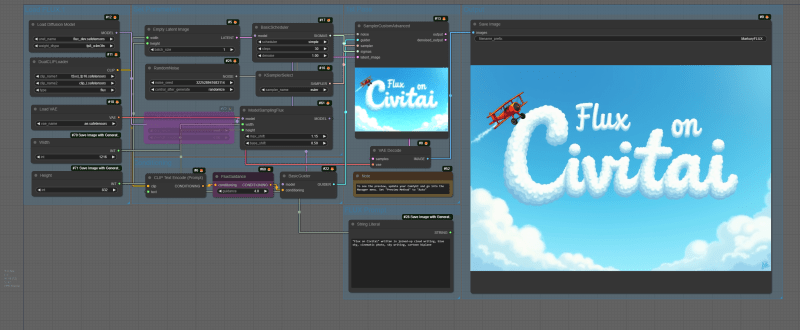

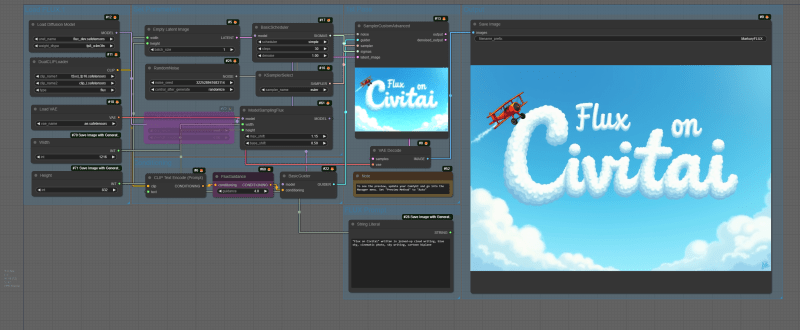

ComfyUI

Flux.1は初日からComfyUIのサポートを受けており、Black Forest Labsのモデルで生成を開始する最も迅速かつ簡単な方法の一つです。ComfyUIでFluxを使用するには、以下のコンポーネントが必要です:

- 注意:Flux-devおよび-schnell .safetensorsモデルはComfyUI\models\unetフォルダーに配置する必要があります。

- ClipモデルはComfyUI\models\clipフォルダーに配置する必要があります。以前にSD3を使用していた場合、必要なClipモデルをすでに持っているかもしれません。

- いくつかのシステム要件の考慮事項;

- flux1-devは12GB以上のVRAMを必要とします。

- flux1-schnellは12GBのVRAMで実行可能です。

- システムRAMが32GB未満の場合は、t5xxl_fp8_e4m3fnテキストエンコーダーを使用してください。t5xxl_fp16バージョンではなく。

⚠️「フルファット」公式モデルを実行できない場合、クリエイターのKijaiがflux1-devとflux1-schnellの圧縮fp8バージョンをリリースしました。画像品質の低下があるかもしれませんが、これらのバージョンは、利用可能なVRAMが少ないユーザーがFluxで生成できるようにします。

始めるには、基本的なテキストから画像へのワークフローも必要です。以下のダウンロードリンクは、いくつかの優れたプリセットオプションを備えた簡単なセットアップを提供します。さらに、すでにCivitaiで最初のFlux LoRAが登場しているため、LoRAローダー(デフォルトではバイパスされています)も含めています!

civitai_flux_t2i_workflowダウンロード

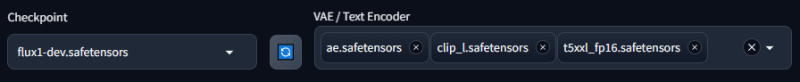

Forge

私たちのお気に入りのインターフェースの一つであるForgeが、驚きのメジャーアップデートでFluxサポートを受けました!Automatic1111のインターフェースに慣れているなら、Forgeはすぐに馴染むでしょう。Gradioのフロントエンドはほぼ同じです。

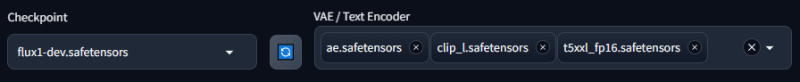

Forgeは、上記のComfyでリストされた元のFluxモデルとテキストエンコーダーをサポートできます。

フルモデルとテキストエンコーダーを使用するには、モデルとエンコーダーを読み込む新しいフィールドがあります;

ForgeのクリエイターであるIllyasvielは、現在FluxをForgeで使用するための推奨方法である「圧縮」NF4モデルをリリースしました。「NF4は6GB/8GB/12GBデバイスでFP8よりも大幅に高速で、16GB以上のVRAMデバイスでもわずかに高速です。6GB/8GB VRAMのGPUでは、速度向上は約1.3倍から2.5倍(pytorch 2.4、cuda 12.4)または約1.3倍から4倍(pytorch 2.1、cuda 12.1)です。」

注意!CUDAが11.7より新しいGPUを使用している場合、NF4モデルを使用できます。ほとんどのRTX3XXXおよび4XXX GPUはNF4をサポートしています。

GPUがGTX10XX/20XXの場合、NF4をサポートしていない可能性があります。この場合は、fp8モデルを使用してください。